https://github.com/rootofdata/AILAB_Sleep-Scoring-Modeling.git

GitHub - rootofdata/AILAB_Sleep-Scoring-Modeling

Contribute to rootofdata/AILAB_Sleep-Scoring-Modeling development by creating an account on GitHub.

github.com

Sleep AI Challenge 2021 ver.2

-적외선 수면 동영상을 이용한 수면 단계 예측

적외선 수면 동영상을 이용하여 30초 간격으로 수면 단계(Wake, Light Sleep(N1, N2), Deep Sleep(N3, REM)) 예측

수면다원검사 중 같이 촬영되는 적외선 수면 동영상은 비접촉식으로 얻어지는 데이터로서, 이러한 문제를 해결할 수 있을 것이라 기대되지만 아직까지는 방대한 양의 데이터에 비해 그 활용성이 매우 낮다.

주어진 영상을 30초 단위로 분석하여 각 시간대의 수면 단계를 예측하는 것이 경진대회의 태스크임.

1건의 검사는 약 6시간의 적외선 수면 동영상 (2020/03/03 22:06:02. ~2020/03/04 06:20:19) 으로 영상이 여러 개로 분할되어 있다.

수면 단계는 검사 시작 시점부터 30초 간격으로 부여되어 있음. e.g. 오후 10시 00분 03초~10시 00분 33초는 Wake, 10시 00분 33초~10시 01분 3초는 N1

주어진 파일

수면다원검사 중 촬영된 적외선 수면 동영상과 어노테이션 파일.

환자1의 파일 -(video, annotation, flow, rgb)

video

각각의 적외선 수면 동영상은 640x480의 해상도, 약 5 FPS의 프레임 레이트를 가지는 MP4 형식의 파일이다.

약 3분가량의 비디오이며 , 6시간의 환자 수면 동영상을 배속해 놓은 영상.

annotation

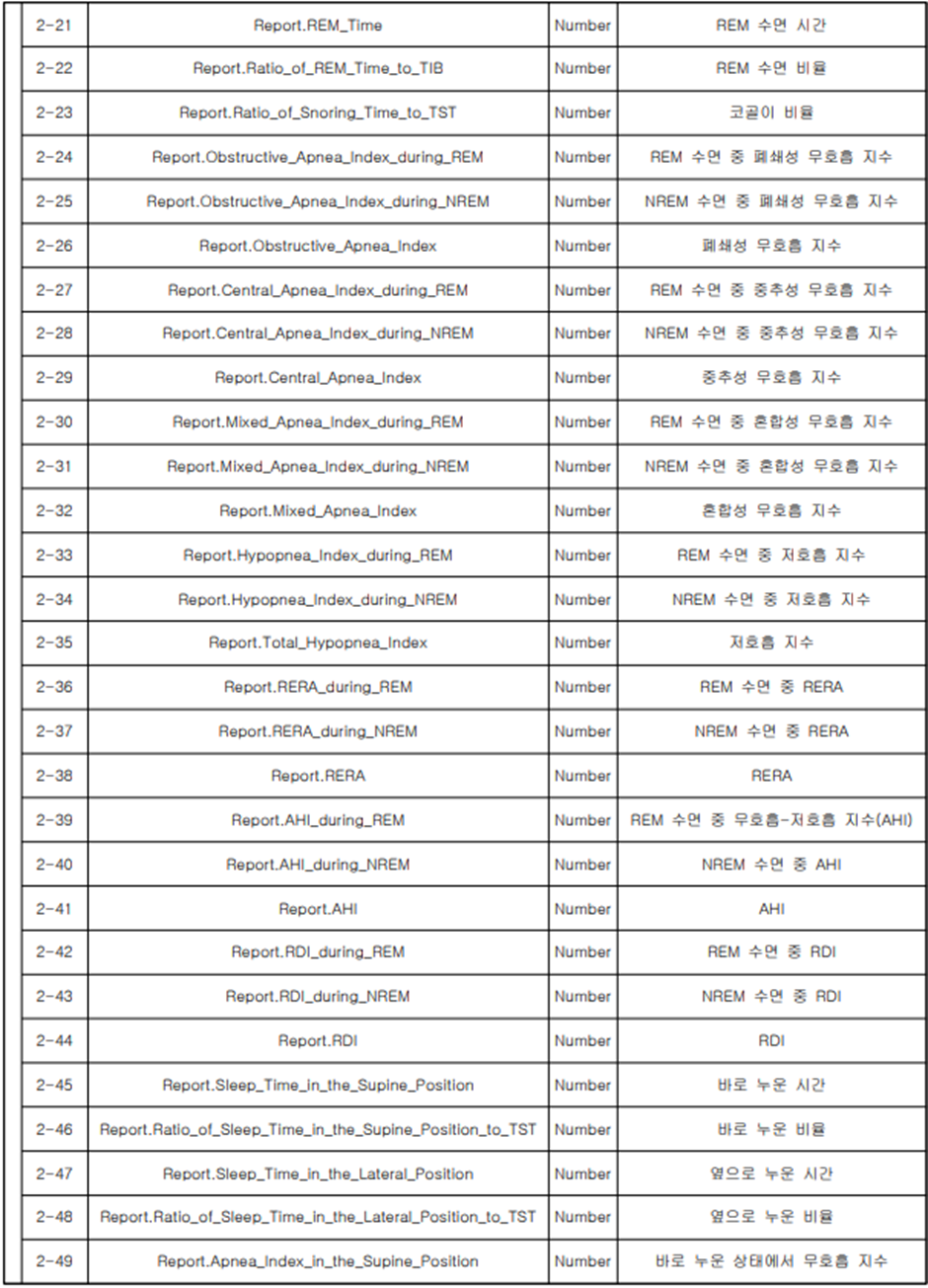

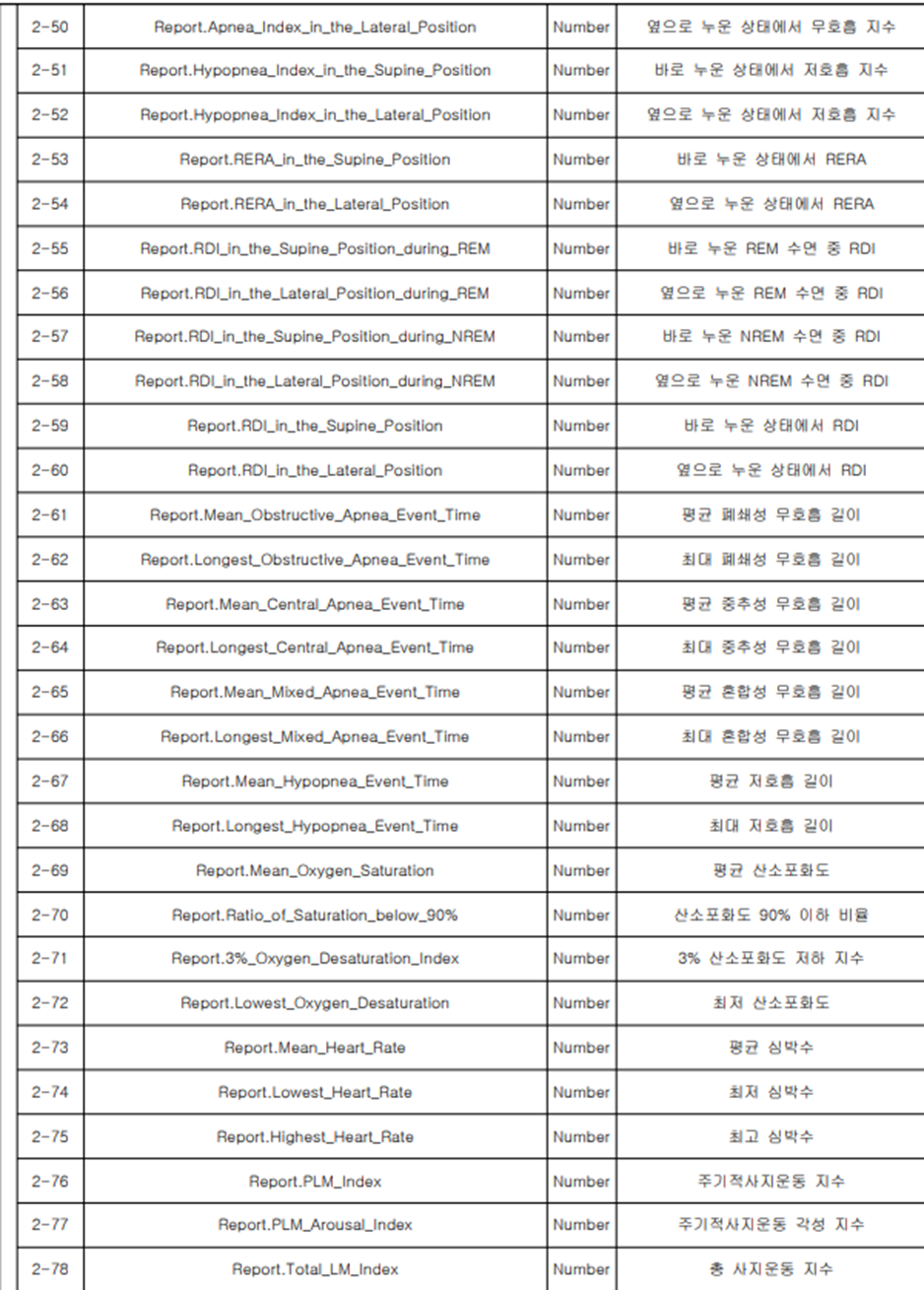

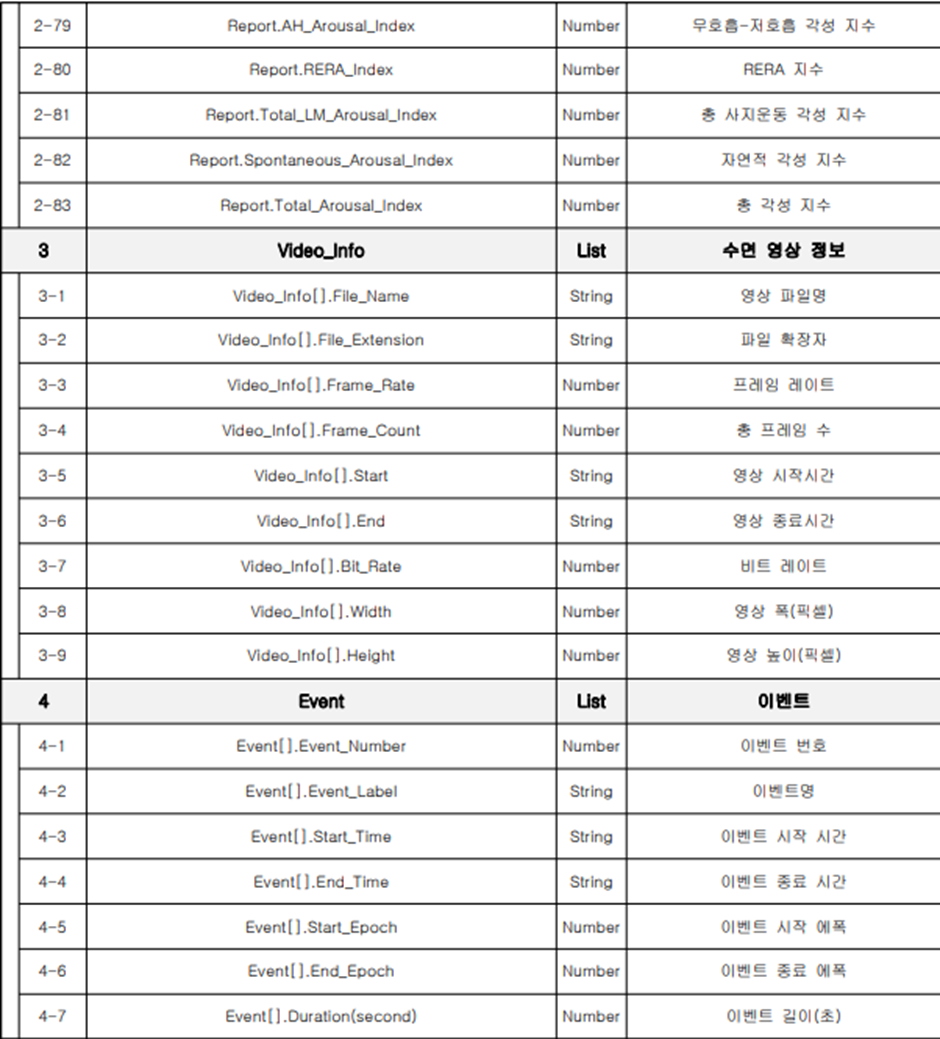

어노테이션 파일은 json 형식으로 저장되어 있으며, 환자에 대한 설명과 수면 이벤트의 정보를 포함하고 있다.

이벤트의 정보에는 각 영상의 시작, 끝 점의 time stamp(절대 시각)와, 30초 마다 판독된 수면 단계에 대한 정보를 포함하고 있다.

환자에 대한 설명은 위와 같은 코드로 표기되어 있으며 이에 따른 ‘어노테이션 파일 항목별 설명’은 마지막장에 사진을 첨부하였다.

어노테이션 파일에 포함된 수면 단계는 총 5가지(Wake, N1, N2, N3, REM)로, N1 단계와 N2 단계를 light sleep으로, N3 단계와 REM 단계를 deep sleep으로 정의하였다.

이벤트 내용은 2421개의 내용으로 구성되어 있으며 기간(duration) 동안 어떠한 상태에 취해있는지에 대한 정보이다.

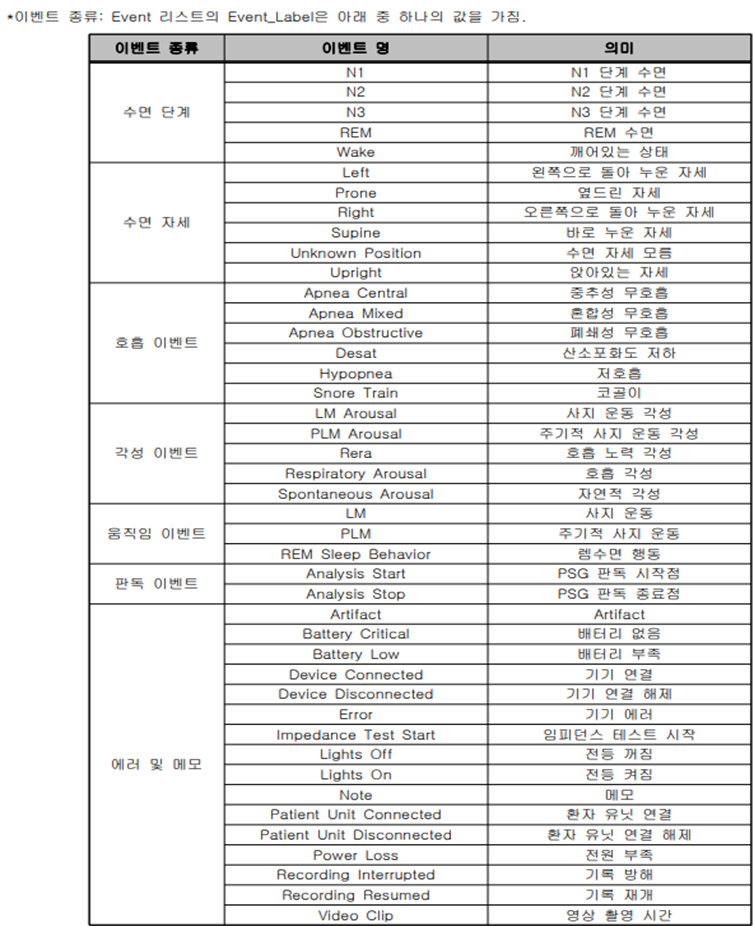

이는 Event_Label이 무엇이냐에 따라 달라지고 Event_Label은 아래 그림과 같다.

FLOW

flow 이미지는 연속된 2장의 rgb 이미지를 이용해 추출하는 것

flow_x와 flow_y가 있는데 아직 모르겠다.

(1800개의 이미지 파일)

예시데이터와 같이 rgb 이미지가 900장인 경우에는 flow 이미지가 (900-1)*2 = 1,798장이 되어야 한다.

RGB

video를 여러 사진으로 쪼갰다, 약 900개의 이미지 파일

결론 : json파일로 된 어노테이션과 video파일을 연관시켜 video(이미지)로 수면단계를 예측할 수 있는 분석을 하려는 시도이며 이를 edf로 어떻게 변환시키느냐와 어떤 관련성이 있는지를 고민해야한다.

'연구 활동 > AI 데이터연구단 과제' 카테고리의 다른 글

| [AI 데이터 연구단] 재난 대응 시나리오 및 주요 행동 요령 (0) | 2022.01.28 |

|---|---|

| 삼성헬스 (갤럭시워치) 데이터 분석 #1 (0) | 2022.01.25 |

| [논문 1-2] 소비자 웨어러블 장치에서 파생된 원시 가속도 및 광혈류 측정기 심박수 데이터를 사용한 수면 단계 예측 (0) | 2022.01.06 |

| [논문 1-1] 소비자 웨어러블 장치에서 파생된 원시 가속도 및 광혈류 측정기 심박수 데이터를 사용한 수면 단계 예측 (0) | 2022.01.06 |

| 수면상태와 뇌파의 연관성 (0) | 2021.12.30 |